L’intelligence artificielle (IA) est de plus en plus intégrée aux technologies que nous utilisons dans notre vie quotidienne. S’il semble anodin d’utiliser l’IA pour supprimer un objet indésirable de l’arrière-plan d’une photo ou pour vous rédiger un contrat, les enjeux sont bien plus importants lorsque cette technologie est introduite dans le domaine de l’imagerie médicale et que son utilisation entraîne des répercussions sur la santé des patients. C’est pourquoi plusieurs grandes institutions radiologiques du monde entier se sont réunies pour publier Developing, Purchasing, Implementing and Monitoring AI Tools in Radiology: Practical Considerations. A Multi-Society Statement From the ACR, CAR, ESR, RANZCR & RSNA.

Le lundi 22 janvier, cette déclaration commune a été publiée dans le Journal de l’Association canadienne des radiologistes (CARJ), Insights into Imaging, le Journal of Medical Imaging and Radiation Oncology, le Journal of the American College of Radiology et Radiology: Artificial Intelligence. La déclaration a été coordonnée par un certain nombre d’organismes médicaux internationaux importants : la CAR, l’American College of Radiology (ACR), la Société Européenne de Radiologie (ESR), la Radiological Society of North America (RSNA) et le Royal Australian and New Zealand College of Radiologists (RANZCR).

Le Dr An Tang, membre de la CAR et coauteur, explique que l’idée de publier la déclaration dans le cadre d’un projet impliquant plusieurs sociétés a germé lors d’un congrès international l’année dernière.

« L’idée est née lors de l’édition 2023 du Congrès européen de radiologie (ECR) qui a eu lieu à Vienne, lorsque le Dr Adrian Brady, alors président du comité relatif à la qualité, à la sécurité et aux normes de la Société Européenne de Radiologie, a proposé de rédiger un document inter-sociétés sur l’adoption de l’IA en radiologie, se souvient le Dr Tang. En raison de la nature de ce type de logiciels, qui peuvent être programmés une fois et déployés partout dans les pays et les juridictions, nous avons estimé qu’il était préférable de publier cette déclaration conjointement par l’intermédiaire de plusieurs sociétés de radiologie à travers le monde. Les livres blancs précédents et les déclarations inter-sociétés couvraient déjà les questions éthiques. Le moment était venu de rédiger un document sur l’adoption des outils d’IA ».

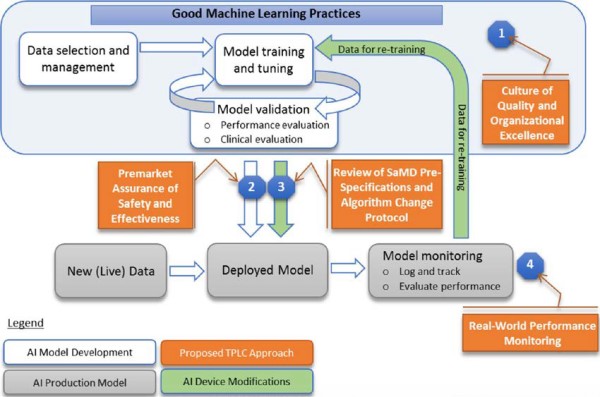

La déclaration vise à définir les « problèmes pratiques potentiels et les questions éthiques entourant l’intégration de l’IA dans la pratique de la radiologie ». Les nouvelles technologies basées sur l’IA sont différentes des systèmes de détection (CADe) et de diagnostic (CADx) assistés par ordinateur qui sont utilisés couramment en radiologie depuis des décennies. « Les algorithmes d’IA modernes, en particulier ceux basés sur l’apprentissage profond, diffèrent fondamentalement de la détection assistée par ordinateur traditionnelle de par l’apprentissage automatique de caractéristiques pertinentes à partir de données sans définition ni programmation explicites, souligne la déclaration. Les algorithmes d’apprentissage profond peuvent apprendre à identifier des modèles dans les images radiologiques en étant formés sur de grands ensembles de données et, en principe, peuvent apprendre en continu et améliorer leurs performances à mesure qu’ils sont exposés à davantage de données. »

Les problèmes pratiques potentiels posés par l’IA nécessitent d’évaluer son efficacité de nouvelles façons avant sa mise en œuvre clinique. « La surveillance et la validation des logiciels d’IA avant leur adoption clinique généralisée sont essentielles pour la sécurité des patients. Nous devons être en mesure de garantir que les modèles fonctionnent au chevet du patient comme ils étaient censés le faire dans les publications préalables à leur mise sur le marché, a déclaré le Dr Tang. Cette surveillance prudente est nécessaire pour garantir la confiance, non seulement au moment de l’achat et de l’installation, mais aussi pendant l’utilisation clinique grâce à une surveillance continue après la mise sur le marché. »

Le Dr Jaron Chong (l’Université Western) est l'un des coauteurs de la déclaration et le président du Comité permanent de l'IA du CAR. Il note que l'environnement de données dans lequel les logiciels d'IA fonctionnent est essentiel à leur fonctionnement.

« Il est important de comprendre que ces modèles d'IA ne fonctionnent pas dans un environnement clinique statique et qu'ils font souvent partie d'un réseau interopérable complexe de matériel et de logiciels en constante évolution, souvent dans des environnements et avec des données qui n'ont pas été initialement prévues ou évaluées par les fournisseurs d'IA », a-t-il déclaré. « La supervision professionnelle est le meilleur mécanisme dont nous disposons pour tirer parti des avantages de ces technologies tout en réduisant les risques et les inconvénients. »

Pour la suite, le Dr Tang note que les possibilités technologiques de l’IA font qu’il est important de continuer à collaborer avec les sociétés internationales afin d’évaluer de manière cohérente les logiciels sur différentes populations et dans différents contextes cliniques.

« La coopération internationale est nécessaire pour s’assurer que les modèles fonctionnent toujours bien auprès de différentes populations et avec des équipements d’imagerie provenant de différents fabricants et associés à différents appareils, paramètres d’acquisition et méthodes de post-traitement », explique-t-il. « La performance des modèles peut dériver au fil du temps, c’est pourquoi la coopération internationale constitue un mécanisme supplémentaire pour garantir la stabilité et la sécurité à long terme des logiciels d’intelligence artificielle. »